Teilen Sie:

Oleksii ist ein Developer Advocate bei Vonage, Autor und Geschichtenerzähler. Seine Interessen umfassen KI/ML, Unified Communications, Bildungstechnologien, Cloud-Technologien und Open Source.

Medienprozessor und AI Video Transformers mit Vonage Video API verwenden

Lesedauer: 2 Minuten

In diesem Artikel werden wir die KI/ML-Tools und -Frameworks untersuchen, die für Entwickler, die mit der Vonage Video API arbeiten, von Nutzen sein können. Außerdem werden wir einige Integrationsbeispiele mit Standardtools untersuchen.

Seit der Pandemie sind viele Menschen ins Home Office umgezogen, und auch heute noch optimieren viele IT-Unternehmen ihre Ausgaben, indem sie Bürogebäude schließen oder verkaufen. Viele Mitarbeiter arbeiten weiterhin von zu Hause aus. Weitere Daten finden Sie in dem Bericht zur Kundenbindung. Dadurch stieg auch die Nachfrage nach neuen Funktionen, die die Privatsphäre und die Konzentration bei Videogesprächen verbessern, wie z. B. Hintergrundunschärfe, Rauschunterdrückung und Sprecherverfolgung. Diese Funktionen sind von Vorteil, wenn Sie von zu Hause aus, in einem Coworking Space und gelegentlich auch vom Flughafen aus arbeiten.

Die Pandemie hat uns dazu gebracht, unsere Arbeitsweise zu überdenken, und Videokonferenzen haben bei diesem Wandel eine wichtige Rolle gespielt. Video Applications treiben die technische Entwicklung voran, und viele KI-Lösungen werden nun in Videokonferenzen integriert.

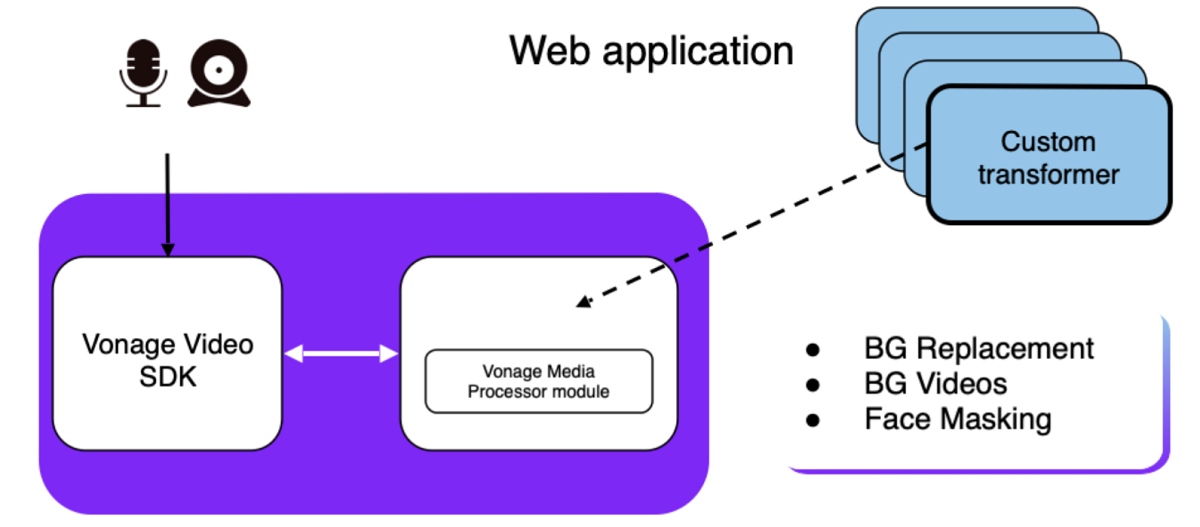

Als Grundlage für die KI-Medienmanipulation haben wir den Media Processor entwickelt - eine Funktion, die die Verwendung der webRTC Insertable Streams API für die Verwendung mit benutzerdefinierten Videotransformatoren vereinfacht. Mit dem Media Processor können Sie ganz einfach eine Reihe von Transformatoren verbinden, durch die die Videobilder laufen. Hintergrundunschärfe oder Rauschunterdrückung sind Beispiele für mögliche Transformatoren. Der Vonage Media Processor ist eine Beschleunigungsbibliothek für Webentwickler, die einfügbare Streams auf Chrome-basierten Browsern mit einem beliebigen Vonage SDK (Voice und Video) verwenden möchten.

@vonage/media-processor ist die Bibliothek, die die Verwendung von Insertable Streams vereinfacht

Die Orchestrierung der Medienpipeline wird von der Bibliothek @vonage/media-processor/MediaProcessor

Steuert die Transformatoren

Ermöglicht setTransformers, setVideoTransformers, setAudioTransformers

Ermöglicht den Anschluss einer Reihe von Transformatoren @vonage/media-processor/MediaProcessorConnector

Verbindet den MediaProcessor mit dem OT Publisher Transformatoren

Klasse, in der Transformationsalgorithmen implementiert werden

ML-Transformatoren bietet Referenzimplementierung

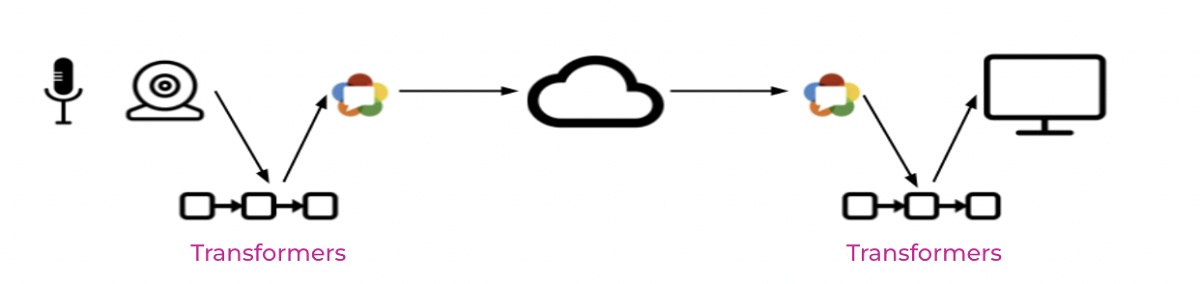

Mit dem Medienprozessor als Grundlage für die Arbeit mit einfügbaren Streams können wir nun Transformatoren einbinden, die die Bewegung von Video- und Audiorahmen erleichtern. Vonage ML transformers ist eine Bibliothek, die maschinelle Lernalgorithmen für das Web implementiert. Diese Bibliothek basiert auf proprietären und Open-Source-Bibliotheken, darunter @vonage/media-processor für die Orchestrierung sowie MediaPipe und TensorFlow Lite (TFLite) für die eigentlichen Videoverbesserungen. TensorFlow Lite ist eine mobile Bibliothek für den Einsatz von Modellen auf Mobiltelefonen, Mikrocontrollern und anderen Endgeräten. Die Bibliothek ermöglicht es Benutzern, beliebige TFLite-Modelle im Web auszuführen, indem sie ein TFLite-Modell von einer URL laden, die Eingabedaten des Modells mit TFJS-Tensoren setzen, die Inferenz ausführen und die Ausgabe in TFJS-Tensoren zurückerhalten. Darüber hinaus enthält es Hilfsklassen, die bei bestimmten Modelltypen, wie z. B. Objekterkennungsmodellen, helfen.

Die MediaPipe-Bibliothek ist eine Open-Source-Bibliothek unter MIT-Lizenz. Für unsere Lösung der Hintergrundunschärfe/-ersetzung verwenden wir die Selfie-Segmentierung Lösung von MediaPipe. Die Bibliothek bietet Unterstützung für alle MediaPipe JS-Lösungen. Dies hilft Entwicklern, coole Projekte mit jedem MediaPipe JS-Modul zu erstellen.

Bibliothek von Vonage, die ML-Algorithmen bereitstellt:

Basierend auf MediaPipe und TFLite

Zugang zu allen MediaPipe (js)-Algorithmen

Selfie-Segmentierung

Gesicht Mesh

Iris-Erkennung

Erkennung der Hand

Objektron

Ganzheitlich

Pose

Bietet Implementierungen für visuelle Effekte:

Hintergrund Unschärfe

Virtueller Hintergrund

Silhouette Unschärfe

Video Hintergrund

Einzelheiten der Durchführung.

Verwendet die MediaPipe Selfie-Segmentierung Lösung.

Der Prozess läuft in einem Webworker.

Die MediaPipe-Lösungen basieren auf WebGL und wasm (SIMD).

Die Lösung wird nicht mit MediaPipe-Binärdateien ausgeliefert. Wir haben statische Assets unter AWS Cloud Front CDN hinzugefügt. Hier sind White-Listed-IPs für Cloud Front.

Mit MediaProcessorConfig können Sie mediapipeBaseAssetsUri definieren, die es dem Benutzer ermöglicht, MediaPipe-Assets selbst zu hosten. Wir empfehlen dies jedoch NICHT.

Haben Sie Ideen, wie Sie Transformers mit Videoinhalten verwenden können? Probieren Sie es mit einer der Beispiel-Applikationen oder erstellen Sie Ihre eigene Anwendung. Zeigen Sie uns Ihre KI-Kreationen, oder lassen Sie uns wissen, wie wir Ihnen helfen können! Beteiligen Sie sich an der Diskussion auf unserem Vonage Community Slack oder senden Sie uns eine Nachricht auf Twitter.