Partager:

With over 5 years of experience in Conversation Design, Luisa deployed hundreds of conversational AI projects for Vonage AI. Now a Product Education Manager for the AI Studio, she's trying to turn everyone into AI enthusiasts by educating them on the capabilities and benefits of the product.

Comment passer d'un bot <> à un humain via un canal de texte sur l'AI Studio

Temps de lecture : 6 minutes

Vonage AI Studio [...] offre aux entreprises une plateforme d'IA conversationnelle Low-Code/No-Code pour gérer les interactions complexes avec les clients.

Quel que soit le flux de conversation que vous créez, vous souhaiterez peut-être ajouter la possibilité pour les représentants humains d'intervenir et de prendre le relais si nécessaire. En tant qu'ancien concepteur de conversations, nous conseillons vivement à toutes les entreprises d'ajouter cette option d'escalade à leurs flux de conversations. Permettre une option de repli élégante pour prendre en charge les cas où l'agent n'est pas en mesure de traiter la requête de l'utilisateur ou lorsque l'utilisateur final demande à parler à un humain est crucial pour maintenir un Net Promoter Score sain et une satisfaction globale du client.

Dans le canal vocal, la conversation peut être transférée via la note " Acheminer l'appel ". Dans les canaux de texte tels que WhatsApp et HTTP, nous pouvons faire appel à un représentant humain en utilisant la note "Agent en direct". Dans cet article de blog, vous apprendrez comment transférer la conversation à un représentant humain en utilisant Slack.

L'agent agent en direct permet à vos utilisateurs finaux d'interagir avec des agents en direct sans jamais devoir quitter la conversation. L'agent en direct aura également un aperçu du contenu de la conversation avant le déclenchement du routage de l'agent en direct. Vous pouvez suivre l'ensemble de la conversation dans les rapports d'AI Studio afin d'optimiser les performances de votre agent.

Live Agent Routing

Live Agent Routing

Veuillez noter que cette démo ne peut prendre en charge qu'une seule session à la fois.

La première chose à faire est de créer notre agent virtuel dans le studio. Nous allons créer un agent pour la société d'électronique fictive "Awesome Internet Support" dans le canal WhatsApp. L'agent virtuel aidera l'utilisateur final à résoudre son problème. Lorsque l'agent virtuel se rendra compte qu'une assistance professionnelle est nécessaire, il transférera la conversation à l'équipe d'assistance. Celle-ci communiquera avec le client sur Slack, tandis que le client lui-même restera dans la même conversation WhatsApp.

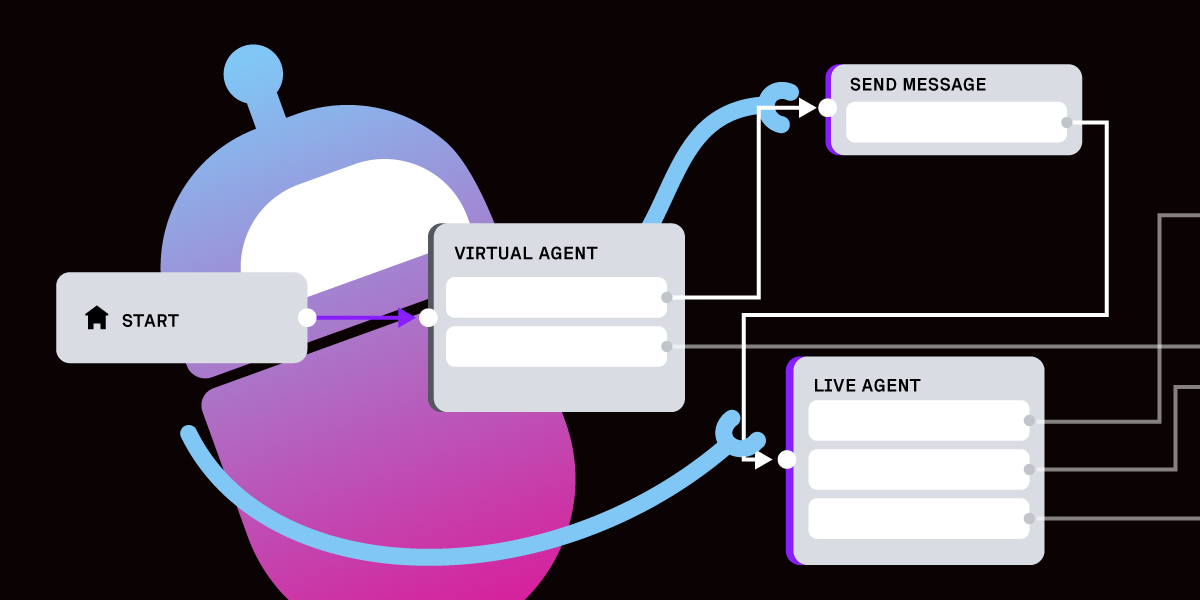

Après avoir créé le flux de l'agent virtuel et l'avoir utilisé pour accueillir le client et lancer la conversation, nous avons ajouté le point de sortie pour le routage de l'agent en direct. Ainsi, nous appelons le nœud Live Agent.

The Virtual Agent Flow so far

The Virtual Agent Flow so far

C'est là qu'intervient le nœud Live Agent. Nous utilisons ce nœud pour communiquer avec l'agent en direct. Il y a deux URL de webhook à remplir. Les autres points de terminaison restent inchangés. Nous ignorerons le point de terminaison de livraison d'état dans ce blog.

Live Agent

Live Agent

Quels sont ces critères ?

Comme nous l'avons mentionné, le nœud de l'agent en direct est un nœud générique qui vous permet de vous connecter à n'importe quel tiers, c'est pourquoi vous devrez construire le connecteur entre AI Studio et votre tiers (dans notre cas, Slack). Nous avons donc construit un connecteur capable d'acheminer la demande de début de conversation et les demandes de messages entrants (de votre client au représentant en direct), ainsi que d'envoyer les demandes de messages sortants (de votre représentant en direct à votre client) et de mettre fin à la conversation.

Endpoint flow

Endpoint flow

Comment avons-nous procédé ?

Tout d'abord, créons le connecteur. Pour cette démo, nous avons utilisé le framework Nest.JS pour construire facilement l'API du connecteur. Nous avons construit deux points d'extrémité pour gérer les demandes de studio -

Code for Start and Message Endpoint

Code for Start and Message Endpoint

Il s'agit dans les deux cas de Post endpoints, et nous extrayons les informations dont nous avons besoin de chacun d'entre eux. Le corps du point de départ contient des informations telles que l'identifiant de la session, la transcription de l'ensemble de la conversation jusqu'à présent, tous les paramètres du système, ainsi que d'autres paramètres que vous avez choisis dans le tiroir de l'agent en direct.

Dans le point de terminaison du message, nous récupérons également l'identifiant de la session et le message (dans notre cas, nous n'attendons que du texte et nous prenons donc immédiatement le champ texte, mais il pourrait également s'agir d'un lien vers n'importe quel fichier multimédia).

Dans l'étape suivante, nous allons transférer les données de notre connecteur vers Slack.

Pour ce faire, nous suivons la documentation de l'API de Slack ici. Pour notre démo de base, nous avons créé une nouvelle application dans slack et nous avons utilisé les fonctionnalités Incoming Webhooks pour envoyer des messages à notre application slack :

Slack Permissions

Slack Permissions

Nous routons le webhook vers un canal Slack que nous avons créé ( vgai-live-agent-test ) - et nous appelons ce webhook depuis notre connecteur, nous l'avons fait en tant que résultat de la demande de démarrage de la conversation et aussi pour les demandes de messages entrants. Cela devrait ressembler à quelque chose comme ça :

Route the WebHook to a Channel

Route the WebHook to a Channel

Le texte est le message que vous souhaitez envoyer.

Afin de permettre au représentant en direct de gérer la conversation avec le client et de communiquer avec lui à l'aide de Slack, nous avons ajouté une nouvelle fonctionnalité à l'application Slack et nous avons créé des commandes Slash. L'une pour envoyer des messages et l'autre pour clore la conversation du client avec le représentant en direct.

Create a New Command

Create a New Command

Nous avons ajouté deux points d'extrémité supplémentaires au connecteur :

An Additional 2 EndPoints

An Additional 2 EndPoints

Le point de terminaison slack/message est connecté à la commande /vgai-message.

Le point de terminaison slack/end est connecté à la commande /vgai-complete.

Dans cette démo, nous envoyons des messages texte à l'utilisateur, ce qui devrait ressembler à ceci :

Send Text Messages back to the User

Send Text Messages back to the User

Nous avons ensuite réalisé l'intégration pour démarrer la conversation et envoyer des messages du client au représentant en direct :

Integration 1

Integration 1

Nous avons également réussi à envoyer des messages au client et à clore la conversation :

Integration 2

Integration 2

Nous pouvons maintenant le tester de bout en bout

Le client se plaint du wifi et l'AV décide qu'une assistance informatique professionnelle est nécessaire :

Customer Scenario

Customer Scenario

À ce stade, le nœud de l'agent en direct déclenche le point final de démarrage de la conversation du connecteur. Le connecteur déclenche un webhooks vers l'application slack, le représentant en direct est en mesure de voir la conversation avec le VA, et toute information supplémentaire que nous voulons choisir :

Transcription

Transcription

Le représentant en ligne pourra désormais communiquer avec le client en utilisant la commande slash /vgai-message.

Live Representative Communicating

Live Representative Communicating

Le client recevra le message sur son canal WhatsApp :

WhatsApp Message that the customer will receive

WhatsApp Message that the customer will receive

Tous deux pourront communiquer entre eux, en utilisant leurs propres canaux :

Communicating with their own channels

Communicating with their own channels

Communicating with their own channels part 2

Communicating with their own channels part 2

Maintenant, au moment où le représentant en direct exécutera la commande /vgai-complete, il fermera la connexion et l'AV pourra reprendre la main :

Live Representative running the command

Live Representative running the command

Les VA qui prennent le contrôle de la conversation :

VA taking control of the conversation

VA taking control of the conversation

L'ensemble de la conversation peut être enregistré et visualisé à des fins d'optimisation dans l'onglet Rapports d'appels de l'AI Studio.

Everything can be recorded in AI Studio

Everything can be recorded in AI Studio

Paramètres supplémentaires dans le nœud de l'agent en direct :

Additional settings in the live agent node

Additional settings in the live agent nodeChoisissez si nous voulons afficher la conversation avec l'agent en direct

Choisir les paramètres que nous voulons transférer au connecteur sur le point de départ de la conversation.

Définir le délai d'attente de la réponse de l'agent en direct

Meilleure pratique - Veillez à informer votre utilisateur final qu'il est dirigé vers un agent en direct avant de lui confier la conversation. Vous pouvez le faire en utilisant le nœud Envoyer un message.

Si vous souhaitez envoyer des médias à l'agent en direct vous ne pouvez le faire que sur le canal WhatsApp. Veuillez consulter la liste des types de médias pris en charge ci-dessous :

Images - jpg, jpeg et png.

Audio - aac, m4a, amr, mp3 et opus

Video - mp4 et 3gpp. (Remarque : seuls le codec vidéo H.264 et le codec audio AAC sont pris en charge).

Fichier - zip, csv, et pdf.

Pour en savoir plus sur les types de supports pris en charge, veuillez consulter cette page.

Vous êtes aussi enthousiaste que nous ? Rendez-vous sur le site de AI Studio pour ajouter ce nœud à votre flux.

Si vous avez des questions ou des commentaires, rejoignez-nous sur le Slack des développeurs de Vonage ou ajoutez votre commentaires via l'AI Studio. Merci de votre lecture et bonne exploration !

Partager:

With over 5 years of experience in Conversation Design, Luisa deployed hundreds of conversational AI projects for Vonage AI. Now a Product Education Manager for the AI Studio, she's trying to turn everyone into AI enthusiasts by educating them on the capabilities and benefits of the product.