Compartir:

Oleksii es Developer Advocate en Vonage, autor y narrador. Sus intereses incluyen IA/ML, comunicaciones unificadas, tecnologías educativas, tecnologías en la nube y código abierto.

Utiliza el procesador multimedia y los transformadores de Video AI con Vonage Video API

Tiempo de lectura: 3 minutos

En este artículo, exploraremos las herramientas y los marcos AI/ML que podrían beneficiar a los desarrolladores que trabajan con Vonage Video API. Además, examinaremos algunas integraciones de muestra usando herramientas estándar.

Desde la pandemia, muchas personas se han trasladado a oficinas en casa y, a día de hoy, muchas empresas de TI siguen optimizando sus gastos cerrando o vendiendo oficinas. Muchos empleados siguen trabajando desde casa. Encontrará más datos en el informe sobre el compromiso del cliente. Esto también ha aumentado la demanda de nuevas funciones que ayuden a la privacidad y al enfoque durante las videollamadas, como el desenfoque del fondo, la reducción del ruido y el seguimiento del interlocutor. Estas funciones son beneficiosas cuando se trabaja desde casa, en un espacio de coworking y, ocasionalmente, desde el aeropuerto.

La pandemia nos ha empujado a replantearnos nuestra forma de trabajar, y las videoconferencias han desempeñado un papel importante en esa transformación. Las Video Applications están impulsando la evolución tecnológica, y muchas soluciones de IA se están integrando ahora en las videoconferencias.

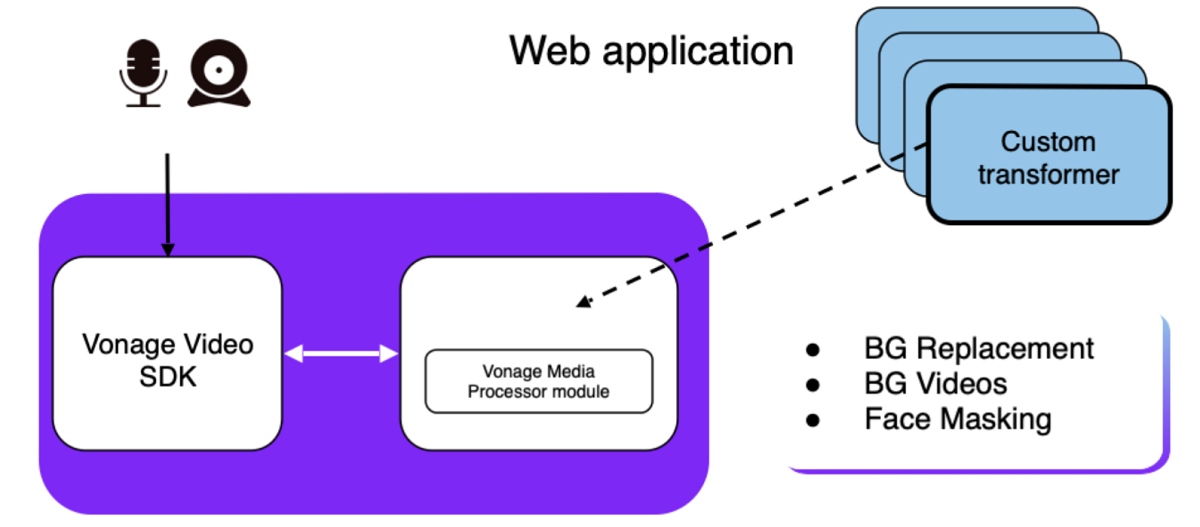

Para sentar las bases de la manipulación multimedia con IA, hemos creado el procesador multimedia, una función que simplifica el uso de la API de flujos insertables de webRTC con transformadores de vídeo personalizados. El Procesador de Medios permite conectar fácilmente una serie de transformadores a través de los cuales viajarán los fotogramas de vídeo. El desenfoque de fondo o la cancelación de ruido son ejemplos de posibles transformadores. Vonage Media Processor es una biblioteca aceleradora para desarrolladores web que desean usar transmisiones insertables en navegadores basados en Chrome usando cualquier SDK de Vonage (Voice y Video).

@vonage/procesador-media es la biblioteca que simplifica el uso de flujos insertables

Orquestación de canalización de medios gestionada por la biblioteca @vonage/media-processor/MediaProcessor

Controla los transformadores

Expone setTransformadores, setTransformadoresVideo, setTransformadoresAudio

Permite conectar series de transformadores @vonage/media-processor/MediaProcessorConnector

Conecta el MediaProcessor con el OT Publisher Transformadores

Clase en la que se aplican los algoritmos de transformación

Los transformadores ML ofrecen una aplicación de referencia

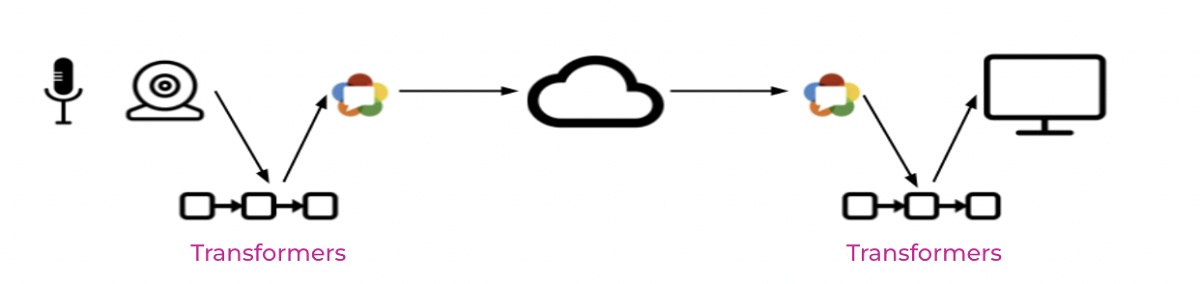

Con el procesador multimedia como base para trabajar con flujos insertables, ahora podemos incorporar transformadores que facilitarán el movimiento de fotogramas de vídeo y audio. Vonage ML transformers es una librería que implementa algoritmos de aprendizaje automático para la web. Esta biblioteca se basa en bibliotecas propietarias y de código abierto, entre las que se incluyen @vonage/media-processor para la orquestación, y MediaPipe y TensorFlow Lite (TFLite) para las mejoras reales de vídeo. TensorFlow Lite es una biblioteca móvil para desplegar modelos en móviles, microcontroladores y otros dispositivos periféricos. La biblioteca permite a los usuarios ejecutar modelos TFLite arbitrarios en la web cargando un modelo TFLite desde una URL, configurando los datos de entrada del modelo con tensores TFJS, ejecutando la inferencia y obteniendo el resultado en tensores TFJS. Además, incluye clases de ayuda para determinados tipos de modelos, como los modelos de detección de objetos.

La librería MediaPipe es una librería de código abierto bajo licencia MIT. Para nuestra solución de desenfoque/reemplazo de fondo utilizamos la librería Segmentación Selfie de MediaPipe. La librería añade soporte para todas las soluciones MediaPipe JS. Esto ayuda a los desarrolladores a crear proyectos geniales con cualquier módulo MediaPipe JS.

Biblioteca de Vonage que proporciona algoritmos ML:

Basado en MediaPipe y TFLite

Acceso a todos los algoritmos de MediaPipe (js)

Segmentación de selfies

Malla facial

Detección del iris

Detección de manos

Objectron

Holístico

Pose

Proporciona implementaciones para efectos visuales:

Desenfoque de fondo

Fondo virtual

Desenfoque de silueta

Video de fondo

Detalles de la aplicación.

Utiliza la Segmentación de selfies MediaPipe de selfies.

El proceso se ejecuta en un web worker.

Las soluciones MediaPipe se basan en WebGL y wasm (SIMD).

La solución no incluye los binarios de MediaPipe. Añadimos activos estáticos bajo AWS Cloud Front CDN. Aquí están las IPs de la lista blanca para Cloud Front.

MediaProcessorConfig le permite definir mediapipeBaseAssetsUri que permite al usuario auto-alojar activos MediaPipe. Sin embargo, NO recomendamos esto.

¿Tienes ideas sobre cómo utilizar Transformers con contenidos de Video? Pruébelo con una de las Aplicaciones de ejemplo o crea una personalizada. Presume de tus creaciones de IA o dinos en qué podemos ayudarte. Únete a la conversación en nuestro Slack de la comunidad de Vonage o envíanos un mensaje en Twitter.