Resumen de los anuncios de Google I/O 2025

Históricamente, Google I/O ha sido una conferencia que entusiasma a los desarrolladores con sus anuncios: gente en paracaídas para presentar Google Glass, o cuando presentaron Kotlin arrastrando y soltando Java a unas pocas líneas de código Kotlin, o incluso cuando se mostró Duplex, destacando las posibilidades de la IA conversacional.

Google I/O es el evento anual que siempre espero con impaciencia. Este año no estuve en Mountain View, pero lo vi todo desde mi sofá. Escuchar los lanzamientos desde el salón de mi casa no es tan emocionante, pero algunos anuncios me entusiasmaron con las nuevas posibilidades para desarrolladores y consumidores.

Esto es lo que más me llamó la atención en Google I/O 2025 como miembro veterano de la comunidad de desarrolladores de Google y desarrollador experto de Google.

Como era de esperar, la IA fue la pieza clave del espectáculo. Un elemento central de la estrategia de Google son sus productos para desarrolladores de consumo, en concreto la familia de modelos Gemini. En concreto, la conferencia destacó Gemini 2.5 Pro (de alto nivel), 2.5 Flash (rápido y asequible), Nano (integrado en el navegador) y Diffusion (experimental, similar al que tenemos para la generación de imágenes pero aplicado a la generación de texto).

Verá a continuación que la mayoría de los anuncios se centraron en gran medida en Géminis. Más información sobre cómo Géminis se vuelve más personal, proactivo y poderoso.

El modo AI es la característica que creo que faltaba, porque desde hace mucho tiempo, el término "búscalo en Google" se ha convertido incluso en una expresión común cuando alguien quiere investigar algo en línea. Sin embargo, especialmente entre las generaciones más jóvenes, he notado un cambio hacia el uso del término "chatearlo" e investigar en plataformas basadas en vídeo, o incluso interactuar con grandes modelos lingüísticos (LLM), para obtener respuestas más complejas y detalladas.

El modo IA, ya disponible en EE.UU., abre la posibilidad de realizar consultas más largas y complejas, y tiene el potencial de cambiar la forma en que interactuamos con la IA. Este nuevo modo de búsqueda te permite recibir respuestas más detalladas, e incluso puede ofrecerte enlaces útiles. Si antes tenías que investigar varias consultas, ahora puedes añadirle más matices y obtener una respuesta potenciada por la IA.

Últimamente, he estado aprendiendo y creando mucho contenido sobre API de red. Una característica realmente potente es la posibilidad de llegar a los usuarios y dispositivos allí donde se encuentren. Por ejemplo, las empresas pueden comprobar el estado de un dispositivo y determinar si capacidades como los datos o los SMS están disponibles para un dispositivo concreto. De este modo, pueden comprobar cuál es el mejor canal disponible en ese momento para sus usuarios. Google ha creado una capacidad similar, pero para ejecutar IA. En Google I/O, anunciaron una forma muy potente de comprobar la capacidad de un dispositivo para ejecutar IA. Si un usuario tiene un dispositivo que no puede ejecutar IA del lado del servidor, han creado una forma de ejecutar IA del lado del cliente. Y esto está disponible en todos los navegadores y dispositivos. La IA del lado del cliente permite una mayor protección de la seguridad de los datos sensibles y la privacidad, al tiempo que permite el uso de la IA del lado del servidor como alternativa. Por ejemplo, cuando el dispositivo está fuera de línea o tiene una mala conexión. Más información sobre cuándo elegir la IA del lado del cliente.

Puedes crear vídeos geniales, teniendo el control de los ángulos, el movimiento y la perspectiva. La forma en que funciona es que puedes describir algo con lenguaje natural, subir tus imágenes o generarlas con Imagen, y ampliarlas con la generación de audio nativa de Veo 3 para crear vídeos con Flujoque forma parte de Google AI Ultra. Utiliza Veo, Imagen y Gemini. Puede ver algunos cortometrajes aquí.

Hace años hice un curso de Android, pero hace tiempo que no hago mucho con este ecosistema. Sin embargo, no podía dejar de hablar de las Smart Glasses de Android XR. Puedes hablar con el asistente de IA sobre todo lo que puedes ver y explorar; Tiene un micrófono, una cámara frontal y altavoces. Ponte al día con todo lo más destacado de Android.

Para crear una extensión de Chrome, necesitamos HTML, CSS y JavaScript. Podemos construirlas localmente y también publicarlas. Hace mucho tiempo, escribí un tutorial de extensión de Chrome para Crea tu primera extensión de Chrome en JavaScript para ocultar tus claves APIpero ahora parece que es un buen momento para crear una nueva porque hay nuevas APIs de AI incorporadas que te permiten usar Gemini Nano en el cliente sin requerir un servidor.

Cuando abras las DevTools en tu navegador Chrome, por ejemplo, haz clic y selecciona "inspeccionar". Verás algunas pestañas: elementos, rendimiento, red, fuentes, etc... ¡Ahora puedes chatear fácilmente con Gemini para que te ayude a depurarlo, probarlo y navegar por él!

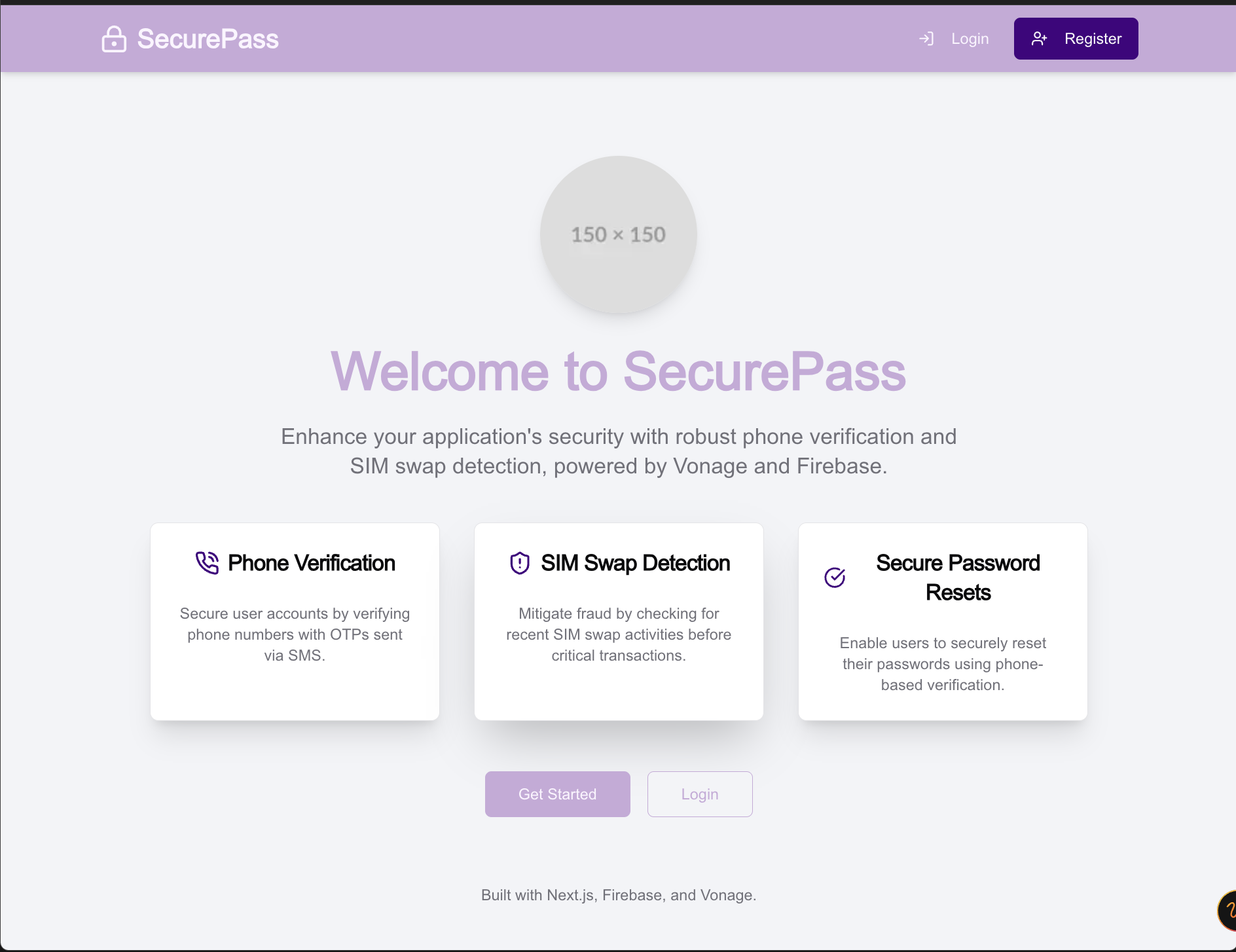

He aquí un ejemplo de su uso, he habilitado la función "Asistencia AI" en la configuración, abrió un proyecto de intercambio Sim que había corriendo en mi localhost:3000 e interactuó con AI en cada pestaña para tratar de entender qué tipo de respuestas que puede dar, en la imagen de abajo le pregunto AI es el fondo de mi contraseña de entrada azul. Me da una respuesta larga adecuada.

AI Assistance in Chrome DevTools

AI Assistance in Chrome DevTools

Firebase Studio ya existe. Está basado en web, construido en VS Code, con vista previa en vivo, una máquina virtual en la nube completa, y más. En Google I/O 2025, se anunciaron nuevas integraciones backend. Es súper interesante y fácil de usar; lo probé con uno de mis proyectos existentes de GitHub. Te daré una visión general a continuación, ¡pero planeo escribir más contenido sobre esta herramienta!

Usted abre Firebase Studioy crea un prototipo de una aplicación con IA escribiéndola con lenguaje natural, también puedes importar código o añadir un repositorio de GitHub y hacer clic para crear un prototipo con IA.

A continuación, crea un proyecto de aplicación personalizable (ver más abajo) que contiene las características, guías de estilo, y el nuevo "Stack" que crea el backend de lo que necesitas (por ejemplo, lo he probado con Cloud Firestore y Firebase Authentication). En pocas palabras, crea el aspecto visual, la parte backend, e incluso determina cómo se almacenan los datos.

App BlueprintPuedes personalizar el aviso, probar todo dentro del emulador con la ayuda de Gemini y, cuando estés listo, puedes hacer clic para publicar en el host y poner en marcha los recursos necesarios.

App BlueprintPuedes personalizar el aviso, probar todo dentro del emulador con la ayuda de Gemini y, cuando estés listo, puedes hacer clic para publicar en el host y poner en marcha los recursos necesarios.

En la demo que probé, añadí el código server.js, y me generó una UI usando TypeScript, Next.js, y Tailwind CSS. Después tuve que ajustar la personalización y las variables de entorno, y finalmente funcionó; pude probarlo todo desde mi navegador y publicarlo.

App UIVe y consulta las principales actualizaciones de Firebase Studio de Google I/O 2025.

App UIVe y consulta las principales actualizaciones de Firebase Studio de Google I/O 2025.

¿Y si existiera un agente de codificación asíncrono al que pudieras asignar tareas? Especialmente las tareas que odias. Puede escribir tus pruebas, y tu documentación, y luego generar un podcast resumen de tu código base. Así podrías centrarte únicamente en la parte de codificación que te gusta hacer.

Bienvenido a Jules. Jules es un agente de codificación asíncrono, y está construido sobre Gemini 2.5.

Adelante y construye con Jules, tu agente de codificación asíncrona.

Hay montones de sitios web y Videos para ver lo que se anunció en Google I/O 2025, como el Lista de reproducción de resúmenes de Google I/O 2025. En esta entrada del blog ofrecí mi punto de vista sobre los anuncios que me parecieron más interesantes. Os mantendré informados de más cosas cuando asista al Google I/O Connect en Berlín y hablar con otros compañeros desarrolladores, asistir a algunos talleres y ver cómo se utilizan estos anuncios en acción.

¿Tienes alguna pregunta o algo que compartir? Únete a la conversación en Slack de la comunidad de Vonagey mantente actualizado con el Boletín para desarrolladoressíguenos en X (antes Twitter)suscríbete a nuestro canal de YouTube para ver tutoriales en video, y sigue la página de página para desarrolladores de Vonage en LinkedInun espacio para que los desarrolladores aprendan y se conecten con la comunidad. Mantente conectado, comparte tu progreso y entérate de las últimas noticias, consejos y eventos para desarrolladores.