Google I/O 2025 Ankündigungen Zusammenfassung

Historisch gesehen, Google I/O war schon immer eine Konferenz, die Entwickler mit ihren Ankündigungen begeisterte: Menschen in Fallschirmen, um Google Glass vorzustellen, oder als sie Kotlin vorstellten, indem sie Java auf ein paar Zeilen Kotlin-Code zogen, oder sogar als Duplex vorgestellt wurde, um die Möglichkeiten der künstlichen Intelligenz zu verdeutlichen.

Die Google I/O ist die jährliche Veranstaltung, auf die ich mich immer freue. Dieses Jahr war ich zwar nicht in Mountain View dabei, aber ich habe alles von meiner Couch aus verfolgt. Es ist zwar nicht so aufregend, die Präsentationen von meinem Wohnzimmer aus zu verfolgen, aber einige Ankündigungen haben mich trotzdem begeistert, weil sie neue Möglichkeiten für Entwickler und Verbraucher bieten.

Als langjähriger Teil der Google Developer Community und Google Developer Expert ist mir auf der Google I/O 2025 Folgendes aufgefallen.

Wie erwartet war KI der wichtigste Teil der Messe. Im Mittelpunkt der Google-Strategie stehen die Entwicklerprodukte für Verbraucher, insbesondere die Gemini-Modellfamilie. Auf der Konferenz wurden insbesondere Gemini 2.5 Pro (Spitzenmodell), 2.5 Flash (schnell und erschwinglich), Nano (in den Browser integriert) und Diffusion (experimentell, ähnlich dem, was wir für die Bilderzeugung haben, aber auf die Texterzeugung angewendet) vorgestellt.

Wie Sie weiter unten sehen werden, konzentrierten sich die meisten Ankündigungen auf Gemini. Erfahren Sie mehr darüber, wie Zwillinge persönlicher, proaktiver und mächtiger wird.

Der KI-Modus ist die Funktion, die meiner Meinung nach gefehlt hat, denn seit langem ist der Begriff "Google it" sogar zu einem gängigen Ausdruck geworden, wenn jemand etwas online recherchieren möchte. Vor allem bei den jüngeren Generationen habe ich jedoch eine Verschiebung hin zum Begriff "Chat it" und zur Recherche auf videobasierten Plattformen oder sogar zur Interaktion mit großen Sprachmodellen (LLMs) festgestellt, um komplexere und detailliertere Antworten zu erhalten.

Der KI-Modus, der jetzt in den USA verfügbar ist, eröffnet die Möglichkeit, längere und komplexere Suchanfragen zu stellen, und hat das Potenzial, die Art und Weise, wie wir mit KI interagieren, zu verändern. Dieser neue Suchmodus ermöglicht es Ihnen, detailliertere Antworten zu erhalten, und er kann sogar hilfreiche Links weiterleiten. Wenn Sie vorher mehrere Anfragen recherchieren mussten, können Sie jetzt mehr Nuancen hinzufügen und eine KI-gestützte Antwort erhalten.

In letzter Zeit habe ich eine Menge über folgende Themen gelernt und erstellt Netzwerk-APIs. Eine wirklich leistungsstarke Funktion ist die Möglichkeit, Nutzer und Geräte dort zu erreichen, wo sie sich befinden. So können Unternehmen beispielsweise den Status eines Geräts überprüfen und feststellen, ob Funktionen wie Daten oder SMS für ein bestimmtes Gerät verfügbar sind. Auf diese Weise können sie prüfen, welcher Kanal für ihre Nutzer in diesem Moment am besten geeignet ist. Google hat eine ähnliche Funktion geschaffen, allerdings für die Ausführung von KI. Auf der Google I/O wurde eine sehr leistungsfähige Möglichkeit angekündigt, ein Gerät auf seine KI-Kapazität zu prüfen. Wenn ein Nutzer ein Gerät hat, das keine serverseitige KI ausführen kann, hat Google eine Möglichkeit geschaffen, KI clientseitig auszuführen! Und dies ist auf allen Browsern und Geräten möglich. Client-seitige KI ermöglicht einen erhöhten Schutz sensibler Daten und der Privatsphäre, während die Server-seitige KI weiterhin als Fallback zur Verfügung steht. Zum Beispiel, wenn das Gerät offline ist oder eine schlechte Verbindung hat. Erfahren Sie mehr darüber wann man sich für client-seitige AI entscheiden sollte.

Sie können coole Videos erstellen und haben dabei die Kontrolle über Winkel, Bewegung und Perspektive. Sie können etwas mit natürlicher Sprache beschreiben, Ihre Bilder hochladen oder mit Imagen generieren und sie mit der nativen Audiogenerierung von Veo 3 erweitern, um Videos zu erstellen mit Flow, das Teil von Google AI Ultra. Es verwendet Veo, Imagen und Gemini. Sie können hier einige Kurzfilme ansehen.

Ich habe vor Jahren einen Android-Kurs belegt, aber es ist schon eine Weile her, dass ich mich viel mit diesem Ökosystem beschäftigt habe. Dennoch konnte ich es nicht lassen, über die Android XR Smart Glasses zu sprechen. Sie können mit dem KI-Assistenten über alles sprechen, was Sie sehen und erkunden können; sie hat ein Mikrofon, eine Frontkamera und Lautsprecher. Informieren Sie sich über alle Android-Highlights.

Um eine Chrome-Erweiterung zu erstellen, benötigen wir HTML, CSS und JavaScript. Wir können sie lokal erstellen und sie auch veröffentlichen. Vor langer Zeit habe ich ein Tutorial für Chrome-Erweiterungen geschrieben, um Erstellen Sie Ihre erste Chrome-Erweiterung in JavaScript, um Ihre API-Schlüssel zu versteckengeschrieben, aber jetzt scheint es ein guter Zeitpunkt zu sein, eine neue zu erstellen, denn es gibt neue eingebaute KI-APIs, die es Ihnen ermöglichen, Gemini Nano auf dem Client zu verwenden, ohne einen Server zu benötigen.

Wenn Sie die DevTools zum Beispiel in Ihrem Chrome-Browser öffnen, klicken Sie auf und wählen Sie "inspizieren". Sie werden einige Registerkarten sehen: Elemente, Leistung, Netzwerk, Quellen usw. Jetzt können Sie ganz einfach mit Gemini chatten, um Ihnen beim Debuggen, Testen und Navigieren zu helfen!

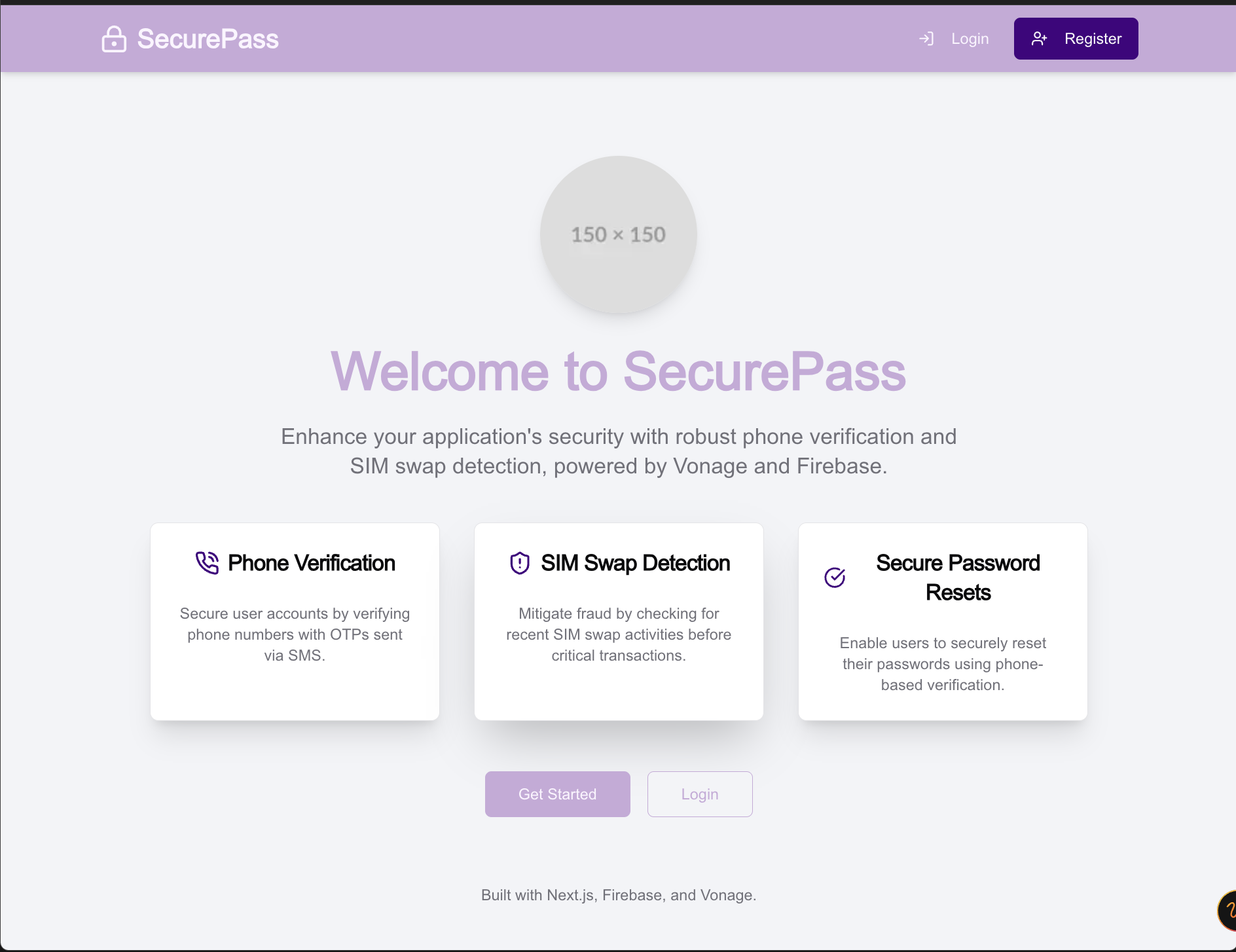

Hier ist ein Beispiel für den Einsatz, ich aktivierte die "AI Assistance"-Funktion in den Einstellungen, öffnete ein Sim-Swap-Projekt, das ich auf meinem localhost:3000 laufen hatte und interagierte mit AI auf jeder Registerkarte, um zu versuchen und zu verstehen, welche Art von Antworten es geben kann, in dem Bild unten frage ich AI ist der Hintergrund meiner Passworteingabe blau. Sie gibt mir eine angemessene lange Antwort.

AI Assistance in Chrome DevTools

AI Assistance in Chrome DevTools

Firebase Studio gibt es schon länger. Es ist webbasiert, in VS Code aufgebaut, mit Live-Vorschau, einer vollständigen Cloud Virtual Machine und mehr. Auf der Google I/O 2025 wurden neue Backend-Integrationen angekündigt. Es ist super interessant und einfach zu bedienen; ich habe es mit einem meiner bestehenden GitHub-Projekte getestet. Im Folgenden gebe ich Ihnen einen Überblick, aber ich habe vor, weitere Inhalte zu diesem Tool zu schreiben!

Sie öffnen Firebase StudioSie können auch Code importieren oder ein GitHub-Repository hinzufügen und dann auf "Prototyping mit KI" klicken.

Anschließend wird ein anpassbarer App-Blaupause (siehe unten) erstellt, die die Funktionen, Styleguides und den neuen "Stack" enthält, der das Backend erstellt, das Sie benötigen (ich habe es zum Beispiel mit Cloud Firestore und Firebase Authentication ausprobiert). Kurz gesagt, es erstellt den visuellen Aspekt, die Backend-Seite und bestimmt sogar, wie die Daten gespeichert werden.

App BlueprintSie können die Eingabeaufforderung anpassen, alles innerhalb des Emulators mit der Unterstützung von Gemini testen, und wenn Sie fertig sind, können Sie auf die Veröffentlichung auf dem Host klicken und die benötigten Ressourcen hochfahren.

App BlueprintSie können die Eingabeaufforderung anpassen, alles innerhalb des Emulators mit der Unterstützung von Gemini testen, und wenn Sie fertig sind, können Sie auf die Veröffentlichung auf dem Host klicken und die benötigten Ressourcen hochfahren.

In der Demo, die ich ausprobierte, fügte ich den server.js-Code hinzu, und es wurde eine Benutzeroberfläche für mich mit TypeScript, Next.js und Tailwind CSS generiert. Ich musste dann die Anpassung und die Umgebungsvariablen feinjustieren, und schließlich funktionierte es; ich konnte alles von meinem Browser aus testen und veröffentlichen.

App UIGehen Sie und die Top Firebase Studio Updates von der Google I/O 2025 ansehen.

App UIGehen Sie und die Top Firebase Studio Updates von der Google I/O 2025 ansehen.

Was wäre, wenn es einen asynchronen Programmieragenten gäbe, den Sie mit der Erledigung von Aufgaben beauftragen könnten? Vor allem die Aufgaben, die Sie hassen. Er kann Ihre Tests und Ihre Dokumentation schreiben und dann eine Podcast-Zusammenfassung Ihrer Codebasis erstellen. Sie können sich dann ausschließlich auf den Teil der Programmierung konzentrieren, den Sie gerne tun.

Willkommen bei Jules. Jules ist ein asynchroner Coding Agent, der auf Gemini 2.5 aufbaut.

Fahren Sie fort und bauen Sie mit Jules, Ihrem asynchronen Kodierungsagenten.

Es gibt tonnenweise Websites und Videos, um zu sehen, was auf der Google I/O 2025 angekündigt wurde, wie zum Beispiel die Google I/O 2025 Zusammenfassungen Playlist. Ich habe meine Sichtweise in diesem Blogbeitrag über die Ankündigungen dargelegt, die mir am interessantesten erschienen! Ich werde Sie auf dem Laufenden halten, wenn ich an der Google I/O Connect in Berlin und mit anderen Entwicklerkollegen spreche, einige Workshops besuche und sehe, wie diese Ankündigungen in der Praxis genutzt werden.

Haben Sie eine Frage oder möchten Sie uns mitteilen, was Sie gerade bauen?

Beteiligen Sie sich am Gespräch auf dem Vonage Community Slack

Abonnieren Sie den Entwickler-Newsletter

Folgen Sie uns auf X (früher Twitter) für Updates

Sehen Sie sich die Tutorials auf unserem YouTube-Kanal

Verbinden Sie sich mit uns auf der Vonage Entwickler-Seite auf LinkedIn

Bleiben Sie auf dem Laufenden und halten Sie sich über die neuesten Nachrichten, Tipps und Veranstaltungen für Entwickler auf dem Laufenden.